要約

Metaが脳の反応を秒単位で予測するオープンソースモデル「TRIBE v2」を公開した。動画を入力すると、どこで脳の反応が上がり下がりするかが見える。下がる箇所を削り、強い場面を前倒しして再編集した結果、1本で221,100回再生を獲得。さらに案件型の投稿報酬では、1,000回再生あたり1〜3ドルの条件なら同規模で約773ドルの試算になる。

Metaが「人間の脳が動画にどう反応するか」をシミュレーションするモデルをオープンソース化した。クリエイターの下書きをそれに通して編集し直したら、221,100回再生まで伸びた。

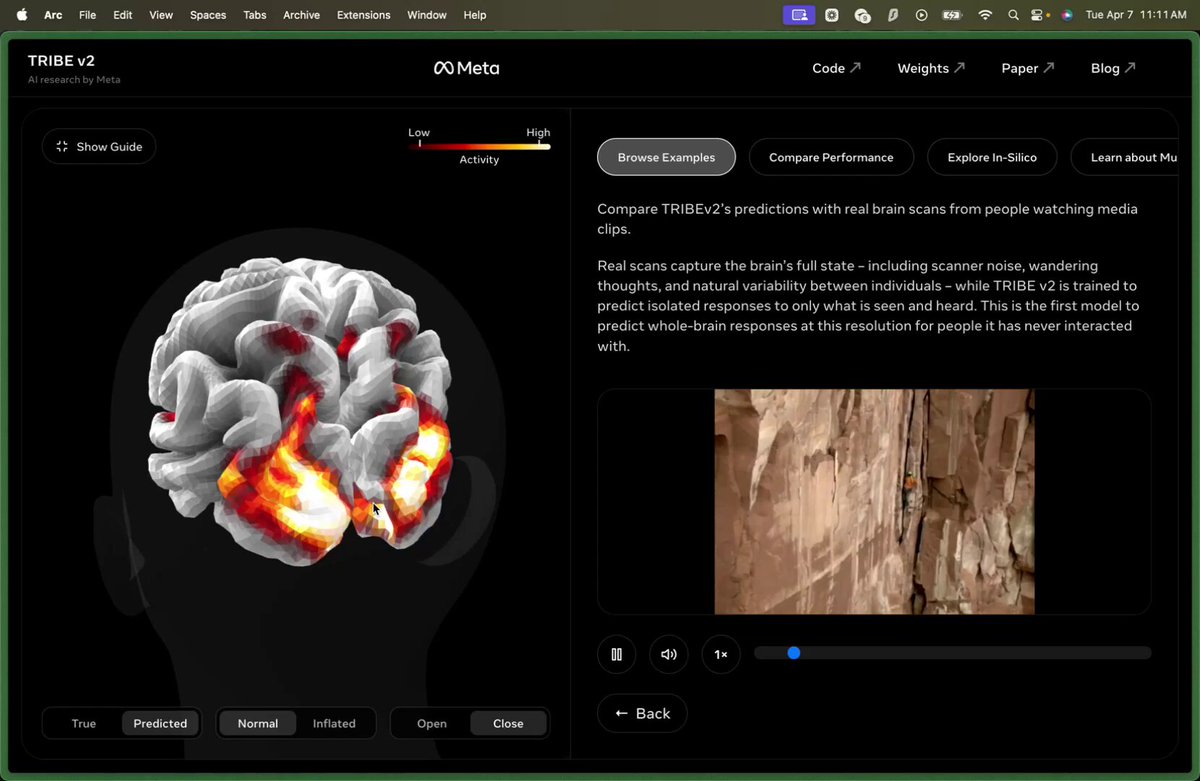

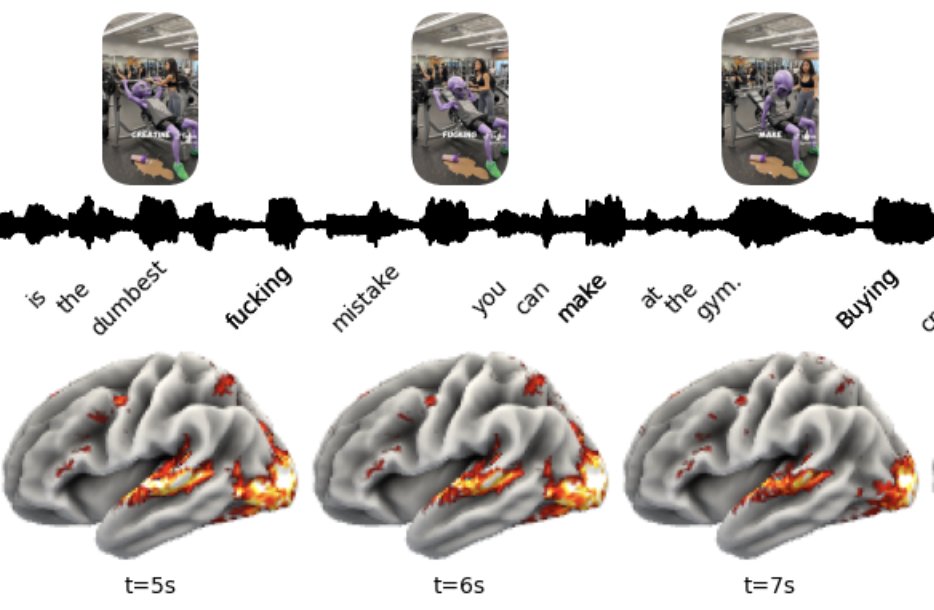

Meta研究チームが数日前に公開したモデルを見つけた。動画・音声・テキストに対する脳の反応を再現し、720人の脳スキャンで学習している。実際にAIのUGC動画で試した。

ここから、TRIBE v2が何か、コードを書かずにセットアップする方法、そしてクリエイターとしてどう収益化するかを具体的に説明する。

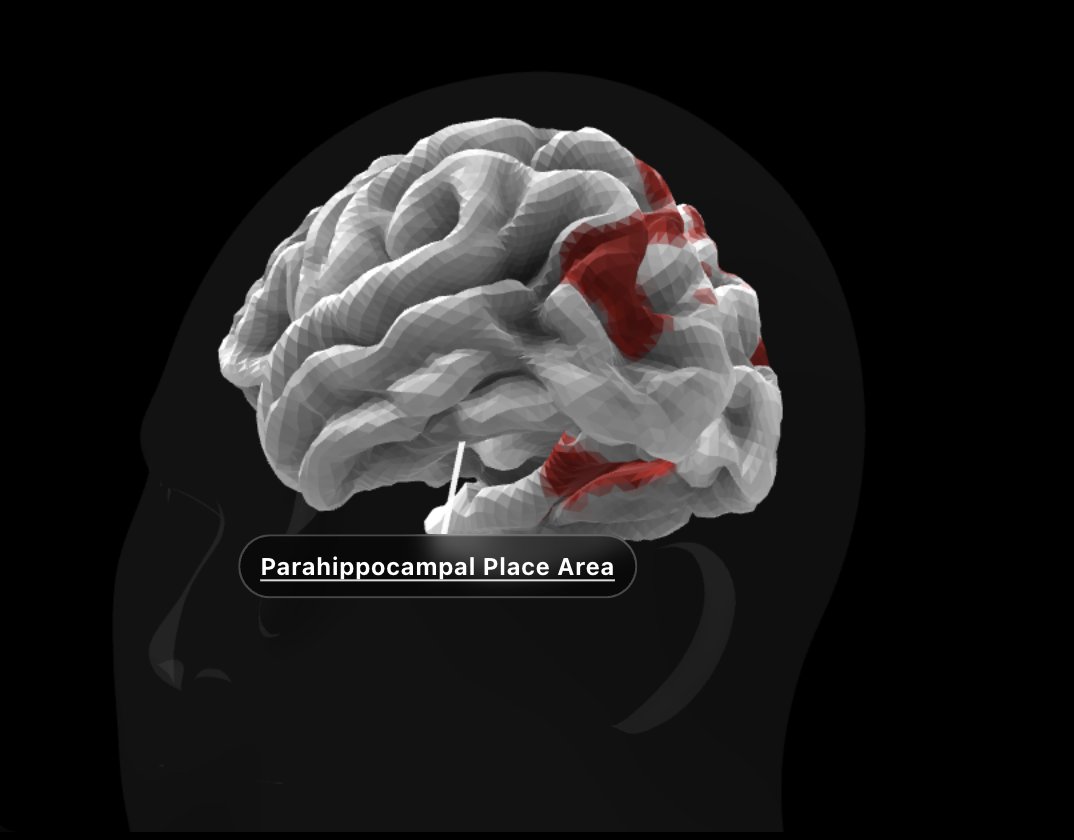

TRIBE v2は700人超の脳スキャンで学習し、動画などを見たときに脳の約7万点がどう反応するかを予測する。動画を渡すと、毎秒どんな反応になるかを返してくる。

MetaのFAIRが720人・1,000時間超の高精細な脳計測で訓練した。ノイズの多い実測より予測のほうが正確だという結果もある。必要なものは全部公開され、無料で使える。

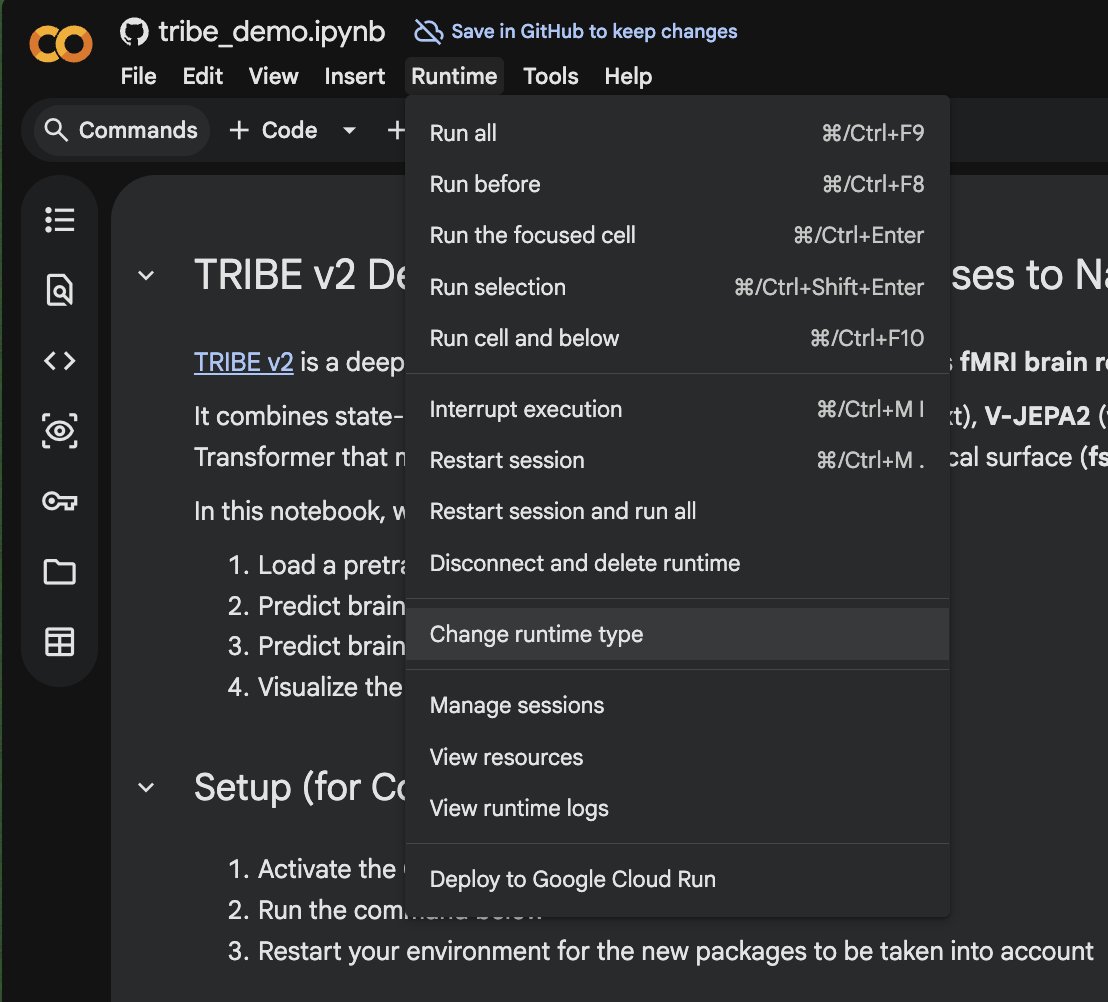

セットアップはコーディング不要。Google Colabを開いてGPUをT4にし、インストールして再起動。Hugging Faceのトークンを作り、テキスト用にLlamaモデルの利用申請もする。

ノートブックの鍵アイコンにHF_TOKENを入れてセルを実行するだけ。サンプル動画で結果を確認でき、任意の動画を入れると「反応が跳ねる秒」と「フラットな秒」が分かる。

実験では、既に編集済みの動画をTRIBE v2に通し、反応が落ちる箇所と上がる箇所を確認。強い場面を前に移し、反応が止まる区間を切り、テンポを組み直した。投稿したら221,100回再生になった。

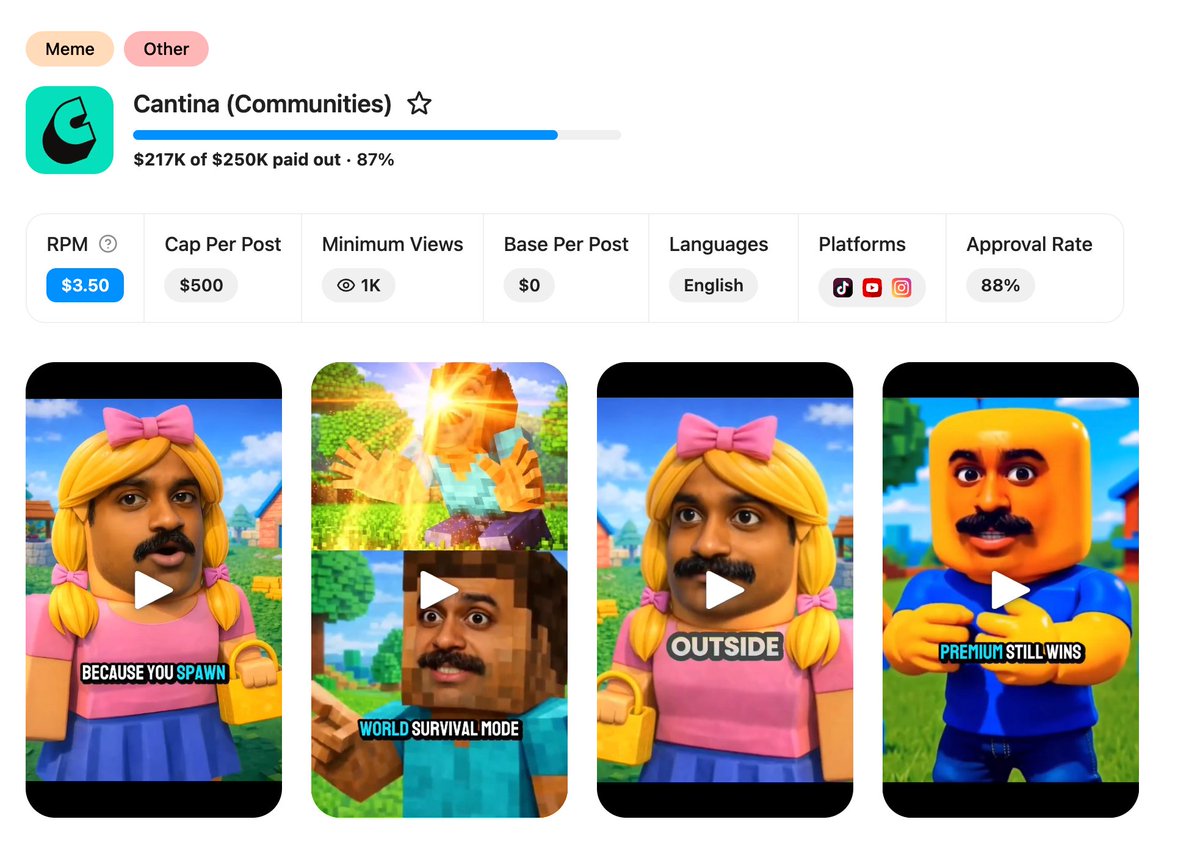

稼ぎ方は、案件に参加して投稿し、1,000回再生あたりの報酬を得る形。1〜3ドルの案件もあり、複数案をTRIBE v2で比較して最も反応が強い版を出す。さらにClaudeで予測→順位付けまで自動化できる。

Key Takeaways

反応が落ちる秒を削るべき

TRIBE v2は秒単位で「脳の反応の落ち込み」を示す。フラットな区間を切るだけでテンポが改善しやすい。

TRIBE v2のColabを開き、GPUをT4に設定して実行する

強い場面は冒頭に前倒しすべき

反応が最も高い瞬間を早い位置へ移動し、最初の離脱を抑える構成に寄せると予測反応が上がりやすい。

Hugging Faceの読み取りトークンを作り、ノートブックにHF_TOKENを登録する

複数案を比較して勝ち案を出すべき

同じ企画でも編集違いの複数バリエーションを作り、TRIBE v2で反応が最も強い版を選ぶと意思決定が速い。

動画の3案を用意し、TRIBE v2で反応が強い版を選んで投稿する

ノーコードで検証環境を作るべき

Google ColabとHugging Faceトークンで動かせる。GPU設定とトークン登録が主な手順で、無料で試せる。

反応が落ちる区間を削り、強い場面を冒頭へ移す再編集を試す

報酬設計は再生数連動で組むべき

1,000回再生あたり1〜3ドルの案件がある前提なら、最適化で再生が伸びた分がそのまま収益に直結する。

予測結果の比較と順位付けをClaudeに任せる運用を作る

評価作業は自動化すべき

Claudeに動画をまとめて流し、TRIBE v2の予測結果で順位付けさせれば、手作業の確認を減らせる。

背景・コンテキスト

短尺動画は数秒単位で離脱が起きやすく、編集の微差が再生数に直結する。秒ごとの反応を可視化できると、修正点の特定が速くなる。

実測の脳計測は高コストでノイズも入りやすいが、学習済みモデルなら同じ入力に対して一貫した指標を返せるため、比較実験に向く。

案件型のクリエイター報酬は再生数に連動することが多く、改善の効果が金額で見えやすい。最適化の投資対効果を計算しやすい領域だ。

実践するなら

- ▸TRIBE v2のColabを開き、GPUをT4に設定して実行する

- ▸Hugging Faceの読み取りトークンを作り、ノートブックにHF_TOKENを登録する

- ▸動画の3案を用意し、TRIBE v2で反応が強い版を選んで投稿する

- ▸反応が落ちる区間を削り、強い場面を冒頭へ移す再編集を試す

- ▸予測結果の比較と順位付けをClaudeに任せる運用を作る